L’essor fulgurant des intelligences artificielles conversationnelles comme ChatGPT, Claude ou Deepseek a révolutionné notre façon d’interagir avec la technologie.

Ces assistants virtuels, capables de générer du texte, de répondre à des questions complexes et même de coder, fascinent autant qu’ils inquiètent.

Si leur potentiel semble illimité, ces IA soulèvent de nombreuses questions en matière de protection des données personnelles et de vie privée.

Quels sont les risques réels et comment se prémunir efficacement ? Plongeons au cœur de cette problématique de taille à l’ère du numérique.

Les mécanismes de collecte de données des IA conversationnelles

Comment fonctionnent les modèles de langage

Les IA conversationnelles reposent sur des modèles de langage entraînés sur d’immenses corpus de textes. Ces modèles analysent les patterns linguistiques pour générer des réponses cohérentes. Chaque interaction avec l’utilisateur enrichit potentiellement la base de connaissances de l’IA.

Elles collectent principalement le contenu des conversations, mais aussi des métadonnées comme l’heure, la durée des échanges ou la localisation approximative. Certains systèmes peuvent également accéder à l’historique de navigation ou aux informations du compte utilisateur.

| Type de données | Exemples | Utilisation potentielle |

|---|---|---|

| Contenu textuel | Messages, requêtes | Amélioration du modèle |

| Métadonnées | Horodatage, localisation | Analyse des usages |

| Données de compte | Email, préférences | Personnalisation |

Comment les entreprises d’IA utilisent les données ?

Les données collectées servent principalement à améliorer les performances des modèles d’IA. Cependant, certaines entreprises peuvent les exploiter à des fins commerciales ou les partager avec des tiers. La transparence sur ces pratiques varie selon les acteurs du marché.

Mettre en place des protections techniques pour vos interactions

Comment utiliser un VPN pour anonymiser sa connexion

Un réseau privé virtuel (VPN) chiffre le trafic internet et masque l’adresse IP réelle de l’utilisateur. Cette technique complique le traçage des activités en ligne et renforce la confidentialité des échanges avec les IA conversationnelles. Choisir un fournisseur VPN fiable s’avère de taille pour garantir une protection optimale.

Choisir des navigateurs et extensions axés sur la vie privée

Des navigateurs comme Tor ou Brave intègrent des fonctionnalités avancées de protection de la vie privée. Des extensions comme uBlock Origin ou Privacy Badger bloquent les trackers et les scripts malveillants. Ces outils limitent la collecte de données personnelles lors des interactions avec les IA.

La plupart des plateformes d’IA proposent des paramètres de confidentialité personnalisables. Il est recommandé de les étudier attentivement et de les configurer de manière restrictive. Certains services payants comme ChatGPT Plus possèdent des options de confidentialité.

Gérer efficacement vos données personnelles avec les IA

| Modèle d’IA | Utilise les données des utilisateurs pour l’entraînement | Option de désactivation | Notes supplémentaires |

|---|---|---|---|

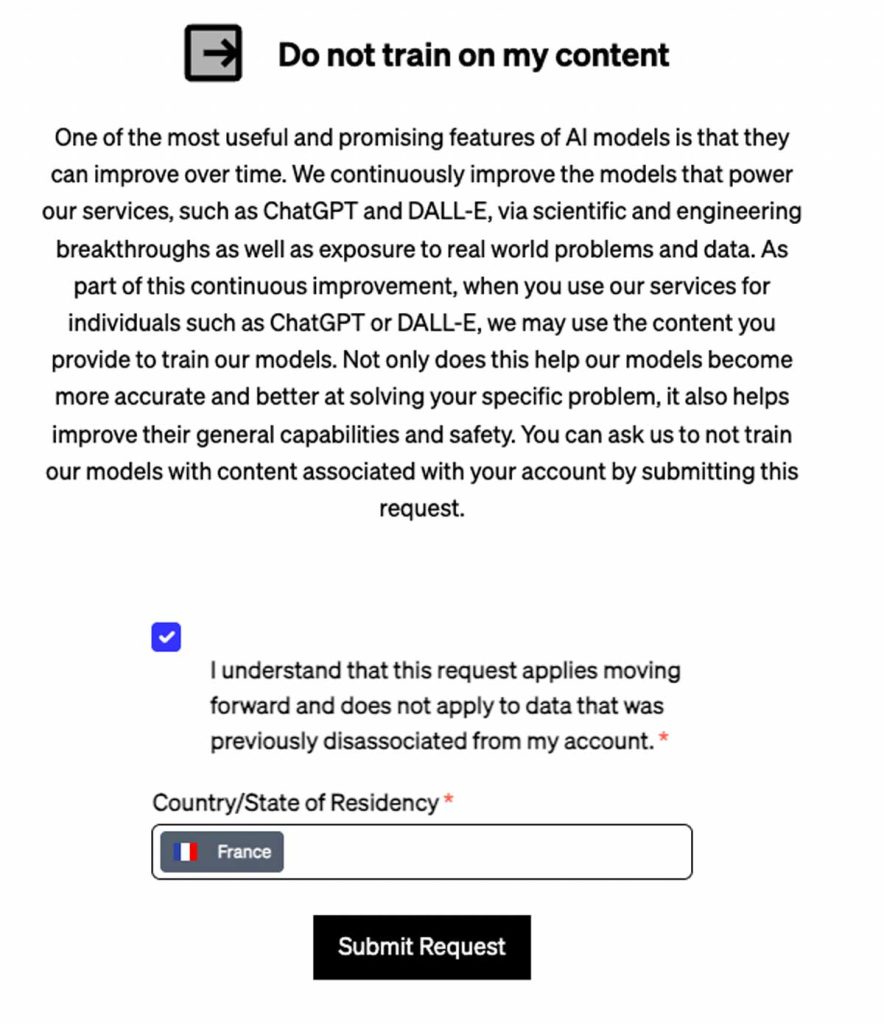

| ChatGPT (OpenAI) | Oui (par défaut pour les plans gratuits) | Oui, via un formulaire ou les paramètres | Pas d’entraînement pour les plans payants comme ChatGPT Business par défaut. |

| Claude (Anthropic) | Non (par défaut) | Non nécessaire, sauf cas spécifiques avec consentement explicite | Utilisé pour la sécurité, pas pour l’entraînement général. |

| Google Gemini | Oui (pour Gemini Apps standalone) | Oui, en éteignant l’activité Gemini Apps | Pas d’entraînement pour Workspace et Cloud. |

| Microsoft Copilot | Non (par défaut) | Non nécessaire, car pas d’entraînement | Conformité RGPD, données non partagées avec OpenAI. |

| Perplexity AI | Oui (par défaut) | Oui, en éteignant l’utilisation des données d’IA dans les paramètres | Données utilisées pour améliorer l’expérience, pas pour les modèles tiers. |

| DeepSeek | Oui | Non clair, peut-être possible sous certaines conditions | Utilise les données des utilisateurs pour l’entraînement des modèles, stockées en Chine, avec des préoccupations de confidentialité. |

| Mistral AI | Oui (sauf pour certains services payants) | Oui, via les paramètres du compte | Les données des utilisateurs sont utilisées pour l’entraînement pour les abonnements gratuits et certains payants, sauf pour Le Chat Team, Enterprise et l’API, où elles ne sont pas utilisées. Les utilisateurs peuvent se désinscrire via les paramètres du compte. |

À noter que vous pouvez demander à ChatGPT de ne pas entraîner leurs modèles avec vos données en vous rendant à cette adresse.

Comment limiter les informations sensibles partagées

La prudence reste de mise concernant les données personnelles communiquées aux IA. Éviter de partager des informations sensibles comme les coordonnées bancaires, les mots de passe ou les documents confidentiels. Privilégier des exemples fictifs ou anonymisés lors des échanges.

Comment nettoyer régulièrement son historique

La plupart des plateformes d’IA permettent de supprimer l’historique des conversations. Cette pratique limite les risques de fuite de données en cas de piratage. Un nettoyage régulier empêche également l’accumulation d’informations personnelles sur les serveurs de l’entreprise.

Le règlement général sur la protection des données (RGPD) accorde aux utilisateurs européens des droits sur leurs données personnelles. Ces droits incluent l’accès, la rectification et la suppression des informations collectées. Ne pas hésiter à les exercer auprès des fournisseurs d’IA pour garder le contrôle sur ses données.

Appliquer des méthodes d’authentification et de sécurisation avancées

Comment activer l’authentification à deux facteurs

L’authentification à deux facteurs (2FA) ajoute une couche de sécurité supplémentaire aux comptes utilisateurs. Cette méthode combine généralement un mot de passe avec un code temporaire envoyé par SMS ou généré par une application dédiée. La 2FA réduit considérablement les risques de piratage des comptes IA.

Comment utiliser un gestionnaire de mots de passe

Les gestionnaires de mots de passe permettent de créer et stocker des mots de passe complexes et uniques pour chaque service. Ces outils renforcent la sécurité des comptes IA en évitant la réutilisation de mots de passe compromis. Ils facilitent également la gestion des identifiants multiples.

Les attaques par injection de prompt visent à manipuler le comportement des IA conversationnelles. Pour s’en protéger, il faut comprendre les mécanismes de ces attaques, comme l’explique cet article sur la définition et les exemples de prompt injection. La vigilance et l’application de bonnes pratiques limitent les risques d’exploitation malveillante des IA.

| Méthode de sécurisation | Avantages | Inconvénients |

|---|---|---|

| Authentification 2FA | Protection consolidée | Processus de connexion plus long |

| Gestionnaire de mots de passe | Mots de passe uniques et complexes | Dépendance à un outil tiers |

| Vigilance anti-injection | Prévention des manipulations | Nécessite des connaissances techniques |

Adopter une hygiène numérique quotidienne avec les IA

Comment éduquer et sensibiliser son entourage

La protection de la vie privée face aux IA concerne tous les utilisateurs. Partager ses connaissances et bonnes pratiques avec son entourage contribue à créer un environnement numérique plus sûr. Les parents ont un rôle particulier à jouer dans l’éducation des enfants aux enjeux de la vie privée en ligne.

Comment rester informé des évolutions technologiques et légales

Le domaine de l’IA évolue rapidement, tout comme les réglementations associées. Se tenir au courant des dernières avancées technologiques et des changements législatifs permet d’adapter ses pratiques. Voici quelques sources d’information fiables :

- Sites spécialisés en intelligence artificielle

- Blogs d’experts en cybersécurité

- Publications officielles des autorités de protection des données

- Newsletters des principaux acteurs du secteur

Un examen périodique de ses habitudes d’utilisation des IA permet d’identifier les failles potentielles. Cet audit personnel peut inclure :

- Révision des paramètres de confidentialité sur chaque plateforme

- Vérification des autorisations accordées aux applications

- Analyse de l’historique des interactions pour repérer d’éventuelles anomalies

- Test des mécanismes de sécurité mis en place (VPN, 2FA, etc.)

Laisser un commentaire